Imaginati-va un hacker care nu doarme niciodata, nu oboseste, nu face greseli si poate lansa mii de atacuri simultan, invatand din fiecare incercare esuat pentru a deveni mai eficient. Acesta nu este un scenariu dintr-un film SF – este realitatea cu care se confrunta organizatiile si utilizatorii obisnuiti in 2024. Inteligenta artificiala a revolutionat aproape fiecare industrie, iar securitatea cibernetica nu face exceptie. Numai ca, spre deosebire de alte domenii unde AI aduce doar beneficii, in lumea securitatii digitale aceeasi tehnologie este folosita atat de aparatori, cat si de atacatori. Rezultatul? O cursa a inarmarilor digitale fara precedent, in care miza sunt datele tale personale, banii tai si chiar infrastructurile critice ale statelor.

Conform unui raport publicat de IBM in 2023, costul mediu global al unei bresle de securitate a atins 4,45 milioane de dolari – un record absolut. In acelasi timp, companiile care au integrat AI in sistemele lor de securitate au reusit sa reduca acest cost cu aproximativ 1,76 milioane de dolari comparativ cu cele care nu au adoptat aceasta tehnologie. Aceste cifre spun o poveste clara: AI nu mai este optional in securitatea cibernetica moderna, ci a devenit o necesitate absoluta. Dar pentru a intelege cu adevarat ce se intampla, trebuie sa privim mai atent atat amenintarile, cat si solutiile pe care aceasta era tehnologica le aduce.

Cum transforma AI peisajul amenintarilor cibernetice

Pana nu demult, atacurile cibernetice urmau un tipar relativ predictibil: hackerii identificau manual vulnerabilitati, scriau cod malitios si lansau campanii care puteau fi, in timp, detectate si blocate. AI a schimbat fundamental aceasta dinamica. Astazi, atacatorii folosesc modele de machine learning pentru a automatiza descoperirea vulnerabilitatilor, pentru a personaliza mesajele de phishing la un nivel de detaliu incredibil si pentru a adapta in timp real comportamentul malware-ului in functie de mediul in care ruleaza.

Un exemplu concret este fenomenul de \”spear phishing\” potentiat de AI. In trecut, un email de phishing era relativ usor de identificat – continea greseli gramaticale, un ton nenatural sau informatii generice. Astazi, modelele de limbaj de tip LLM (Large Language Model) pot genera mesaje perfect personalizate, folosind informatii publice despre tinta (de pe LinkedIn, Facebook sau alte retele sociale), imitand stilul de scriere al unui coleg sau superior si creand un context extrem de credibil. Rata de succes a acestor atacuri a crescut, potrivit unor studii, cu peste 60% fata de metodele traditionale.

Mai ingrijorator este fenomenul „polymorphic malware” – software malitios care isi modifica singur codul folosind AI, pentru a evita detectia de catre solutiile antivirus traditionale bazate pe semnaturi. Fiecare noua instanta a virusului arata diferit din punct de vedere tehnic, dar face acelasi lucru daunatorgenerand o provocare uriasa pentru securitatea traditionala bazata pe liste negre si semnaturi statice.

Deepfake-urile si noua dimensiune a fraudei digitale

Una dintre cele mai alarmante aplicatii ale AI in atacurile cibernetice este tehnologia deepfake. Daca pana acum falsificarea identitatii digitale implica efort considerabil si rezultate imperfecte, astazi un deepfake video sau audio de calitate poate fi generat in cateva minute cu instrumente accesibile publicului larg. Implicatiile pentru securitate sunt devastatoare: de la fraude financiare la atacuri de inginerie sociala la nivel corporativ.

Un caz real si extrem de mediatizat s-a petrecut in Hong Kong in 2024, cand un angajat al unei companii financiare a fost convins sa transfere 25 de milioane de dolari dupa ce a participat la o videoconferinta in care toti „colegii” si „directorul financiar” erau, de fapt, deepfake-uri generate de AI. Angajatul nu a observat nimic suspect in timpul apelului – vocile, mimica si contextul pareau perfect reale. Acesta este poate cel mai dramatic exemplu al modului in care AI poate fi weaponizat impotriva organizatiilor.

La nivel individual, deepfake-urile audio sunt folosite pentru a imita vocile rudelor sau prietenilor in situatii de urgenta fabricate, cerandu-se transferuri de bani urgente. Europol a avertizat in 2023 ca aceste atacuri vor deveni din ce in ce mai frecvente si mai greu de detectat pe masura ce tehnologia devine mai accesibila si mai performanta. Romania nu este imuna la acest fenomen – cazuri de frauda deepfake audio au fost raportate si la noi, mai ales in randul persoanelor varstnice.

AI in aparare: cum lupta algoritmii impotriva hackerilor

Din fericire, aceeasi tehnologie care ii inarmeaza pe atacatori este folosita si de aparatori, adesea cu rezultate remarcabile. Sistemele de securitate bazate pe AI pot analiza volume uriase de date in timp real, identificand tipare anormale care ar scapa oricarui analist uman. Un sistem modern de SIEM (Security Information and Event Management) potentiat de AI poate procesa milioane de evenimente pe secunda, corelandu-le si prioritizand alertele cu o precizie mult mai mare decat metodele traditionale.

Conceptul de „behavioral analytics” reprezinta poate cea mai valoroasa contributie a AI in securitatea defensiva. In loc sa caute semnaturi cunoscute ale atacurilor, aceste sisteme invata cum arata comportamentul normal al unui utilizator sau al unui sistem si ridica alerte atunci cand apar abateri semnificative. Daca contul tau de email trimite brusc 500 de mesaje intr-un minut sau daca un server acceseaza fisiere la ore neobisnuite si in cantitati neobisnuite, AI-ul detecteaza anomalia inainte ca daunele sa devina semnificative.

Companii precum Darktrace, CrowdStrike sau SentinelOne au construit platforme de securitate care folosesc AI pentru a replica, la scara digitala, ceva similar cu sistemul imunitar uman – capacitatea de a recunoaste si de a raspunde la amenintari necunoscute anterior. Darktrace, de exemplu, foloseste un model de AI nesupervizat care invata in mod continuu „normalul” pentru fiecare organizatie si actioneaza autonom pentru a contine amenintarile, chiar inainte ca analistii umani sa fie alertati.

Vulnerabilitatile modelelor AI: cand aparatorul devine tinta

Exista insa un aspect mai putin discutat, dar extrem de important: modelele AI insele pot fi tinte sau vectori de atac. Atacurile de tip „adversarial AI” implica manipularea datelor de intrare pentru a pacali un model de AI sa ia decizii gresite. In securitatea cibernetica, asta inseamna ca un atacator sofisticat poate, teoretic, sa modifice subtil un malware astfel incat sistemul AI de detectie sa il clasifice ca benign.

„Prompt injection” este o alta vulnerabilitate specifica modelelor de limbaj mari. Prin inserarea unor instructiuni malitioase in datele procesate de un chatbot sau asistent AI, un atacator poate determina modelul sa execute actiuni nedorite, sa divulge informatii confidentiale sau sa ocoleasca filtrele de securitate. Pe masura ce companiile integreaza tot mai mult AI in fluxurile lor de lucru critice, aceasta categorie de vulnerabilitati devine din ce in ce mai relevanta.

„Data poisoning” reprezinta o alta amenintare serioasa: prin contaminarea datelor de antrenament ale unui model AI cu exemple malitioase, un atacator poate introduce „backdoor-uri” in sistem – comportamente ascunse care se activeaza la anumiti stimuli. Acest tip de atac este deosebit de periculos deoarece poate ramane nedetectat pentru o perioada lunga, iar identificarea sa necesita o auditare extrem de riguroasa a intregului pipeline de antrenament.

Reglementari si cadrul legal: Europa incearca sa tina pasul

In fata acestor provocari, autoritatile de reglementare din intreaga lume incearca sa creeze un cadru legal adecvat. Uniunea Europeana a facut pasi importanti in aceasta directie cu AI Act, primul set comprehensiv de reglementari dedicate inteligentei artificiale la nivel mondial, adoptat in 2024. Aceasta legislatie clasifica aplicatiile AI dupa nivelul de risc si impune cerinte stricte pentru sistemele considerate „cu risc inalt”, inclusiv cele folosite in securitate si infrastructuri critice.

In Romania, Directiva NIS2 (Network and Information Security), transpusa in legislatia nationala, extinde semnificativ obligatiile de securitate cibernetica la un numar mai mare de sectoare si companii. Organizatiile afectate trebuie sa implementeze masuri tehnice si organizatorice adecvate, sa raporteze incidentele semnificative in termen de 24-72 de ore si sa efectueze evaluari regulate de risc. Nerespectarea acestor cerinte poate atrage amenzi substantiale – pana la 10 milioane de euro sau 2% din cifra de afaceri globala pentru entitatile esentiale.

DNSC (Directia Nationala de Securitate Cibernetica) din Romania a intensificat in ultimii ani eforturile de constientizare si raspuns la incidente, publicand rapoarte regulate despre amenintarile cu care se confrunta mediul digital romanesc. Conform celui mai recent raport anual, sectorul financiar-bancar, cel al sanatatii si infrastructurile de transport raman cele mai vizate, iar atacurile de tip ransomware continua sa fie principala amenintare pentru organizatiile romanesti.

Ransomware-ul in era AI: o amenintare amplificata

Ransomware-ul – acel tip de malware care iti cripteaza fisierele si cere rascumparare pentru a le recupera – a evoluat dramatic odata cu integrarea AI. Grupurile criminale moderne nu mai functioneaza ca hackeri solitari, ci ca organizatii profesioniste cu departamente de „cercetare si dezvoltare”, care folosesc AI pentru a identifica cele mai valoroase tinte, pentru a optimiza momentul atacului si pentru a negocia suma de rascumparare in functie de capacitatea financiara a victimei.

Modelul „Ransomware-as-a-Service” (RaaS) a democratizat accesul la aceste unelte: grupuri criminale specializate ofera platforme complete de atac altor infractori, percepand un comision din rascumparerile obtinute. AI este folosit in aceste platforme pentru a automatiza recunoasterea tintelor, pentru a identifica momentul optim de lansare a atacului (de obicei vineri seara sau in perioadele de concediu) si pentru a maximiza impactul prin criptarea selectiva a datelor cele mai critice.

In 2023, grupul Cl0p a exploatat o vulnerabilitate in software-ul MOVEit Transfer, afectand peste 2.000 de organizatii la nivel global, inclusiv agentii guvernamentale americane, universitati si companii mari. Suma totala a pagubelor a fost estimata la peste 10 miliarde de dolari. In Romania, atacul ransomware asupra Spitalului Witting din Bucuresti in 2023 a scos in evidenta vulnerabilitatea sistemului de sanatate romanesc si consecintele dramatice pe care le poate avea o bresa de securitate in infrastructuri critice.

Sfaturi practice: cum te protejezi in era AI

In fata unui peisaj al amenintarilor atat de complex, ce pot face utilizatorii obisnuiti si organizatiile mici si mijlocii pentru a se proteja? Primul si cel mai important pas ramane igiena de baza in securitate cibernetica, care nu s-a schimbat fundamental: parole puternice si unice pentru fiecare cont, autentificare in doi factori (2FA) activata oriunde este posibil, actualizari regulate ale software-ului si sistemului de operare si backup-uri frecvente ale datelor importante, stocate offline sau in cloud cu criptare puternica.

Educatia si constientizarea reprezinta insa arma cea mai puternica. Intr-o lume in care deepfake-urile si email-urile de phishing generate de AI sunt aproape imposibil de distins de comunicarile legitime, trebuie sa devii sceptic in mod sanatos. Verifica intotdeauna prin alt canal (un apel telefonic la un numar cunoscut, nu la cel din mesaj) orice cerere urgenta de transfer de bani sau de acces la date sensibile, indiferent cat de legitima pare sursa. Introduce o „parola secreta” cu familia pentru situatii de urgenta, pentru a te proteja de atacurile deepfake audio.

Pentru organizatii, adoptarea unui model de securitate „Zero Trust” este recomandata din ce in ce mai mult. Principiul de baza este simplu dar puternic: nu te incredere implicit in nimeni si nimic, nici macar in utilizatorii sau dispozitivele din reteaua interna. Fiecare cerere de acces trebuie verificata, autentificata si autorizata, indiferent de sursa. Combinat cu solutii de securitate bazate pe AI pentru detectia anomaliilor si cu training regulat al angajatilor, acest model reduce dramatic suprafata de atac a unei organizatii.

Foloseste un manager de parole pentru a crea si stoca parole complexe unice, activeaza notificarile de securitate de la bancile si serviciile tale online, monitorizeaza periodic daca adresa ta de email a aparut in brese de date cunoscute (servicii ca HaveIBeenPwned.com sunt gratuite si extrem de utile) si fii precaut cu ce aplicatii instalezi si ce permisiuni le acorzi. Acesti pasi simpli, aplicati consecvent, te plaseaza cu mult deasupra mediei in termeni de securitate personala.

Viitorul: AI vs AI intr-o batalie fara sfarsit

Pe masura ce ne uitam spre viitor, devine evident ca securitatea cibernetica va fi din ce in ce mai mult un domeniu in care AI se lupta cu AI, cu oamenii in rol de strategi si arbitri. Sistemele autonome de aparare vor reactiona la atacuri in milisecunde, mult mai rapid decat ar putea orice echipa umana. Companiile de securitate investesc masiv in asa-numitele „AI red teams” – sisteme AI antrenate special sa gandeasca si sa actioneze ca atacatorii, pentru a descoperi vulnerabilitatile inainte ca hackerii reali sa o faca.

Computatia cuantica adauga un alt strat de complexitate acestei ecuatii. Desi inca in faze incipiente de maturizare, calculatoarele cuantice ar putea, in teoretic, sa sparga algoritmii de criptare folositi astazi pentru a proteja comunicatiile si datele sensibile. Aceasta perspectiva a determinat deja NIST (National Institute of Standards and Technology) din SUA sa standardizeze in 2024 primii algoritmi de criptografie post-cuantica, meniti sa reziste atacurilor calculatoarelor cuantice.

Specialistii in securitate vor deveni din ce in ce mai cautati, iar profilul lor va evolua: in viitor, un expert in securitate cibernetica va trebui sa inteleaga nu doar retelele si sistemele de operare, ci si arhitectura modelelor AI, principiile de machine learning si psihologia ingineriei sociale. Universitatile si platformele de e-learning din intreaga lume, inclusiv din Romania, au inceput deja sa isi restructureze programele de securitate cibernetica pentru a integra aceste competente esentiale.

Intr-o lume in care frontierele dintre fizic si digital se sterg, in care masinile, casele si orasele sunt conectate la internet, iar decizii critice sunt luate de algoritmi, securitatea cibernetica nu mai este o problema exclusiv tehnica – este o problema de siguranta nationala, de protectie a drepturilor individuale si de integritate a societatii in ansamblu. Era AI ne-a oferit instrumente extraordinare, dar a ridicat si miza la un nivel fara precedent.

Concluzia acestei povesti nu este nici optimista, nici pesimista – este realista. AI reprezinta simultan cea mai mare oportunitate si cea mai mare provocare pe care securitatea cibernetica a intalnit-o vreodata. Cei care vor castiga aceasta batalie nu vor fi neaparat cei cu cei mai buni algoritmi, ci cei care vor reusi sa combine inteligenta artificiala cu cea umana, sa cultive o cultura autentica a securitatii, sa investeasca in educatie si sa coopereze international impotriva amenintarilor comune. Intr-un razboi digital fara granite, apararea trebuie sa fie la fel de globala si de adaptabila ca si atacul. Iar primul pas incepe cu fiecare dintre noi, cu alegerile pe care le facem zilnic in spatiul digital.

Related posts

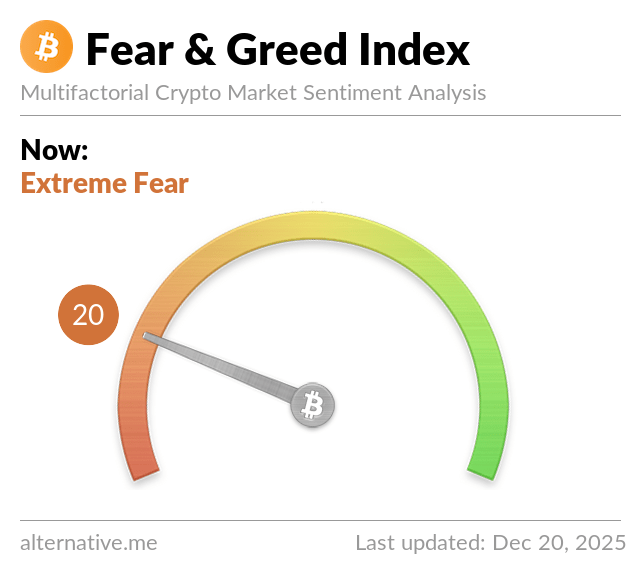

Crypto Fear Level