Traim intr-o epoca in care inteligenta artificiala nu mai este un concept din filmele science-fiction, ci o realitate care remodeleaza fiecare aspect al vietii noastre digitale. De la asistentii virtuali care ne organizeaza agenda pana la algoritmii care decid ce stiri citim dimineata, AI-ul este pretutindeni. Dar aceasta revolutie tehnologica vine la pachet cu o provocare uriasa, una pe care specialistii in securitate cibernetica o numesc deja cea mai mare schimbare de paradigma din istoria domeniului: inteligenta artificiala este acum folosita atat pentru a ne proteja, cat si pentru a ne ataca. Si, sincer vorbind, lupta aceasta nu a fost niciodata mai complexa, mai rapida sau mai periculoasa.

Conform unui raport publicat de Cybersecurity Ventures, daunele globale cauzate de criminalitatea cibernetica vor depasi 10.5 trilioane de dolari anual pana in 2025. Un numar care, daca il scriem intreg, arata asa: 10.500.000.000.000 de dolari. Pentru comparatie, PIB-ul Romaniei este de aproximativ 300 de miliarde de dolari. Vorbim, asadar, despre o industrie criminala mai profitabila decat comertul global cu droguri. Iar AI-ul a devenit cel mai nou si cel mai puternic instrument din arsenalul atacatorilor, dar si al aparatorilor. In randurile urmatoare, vom explora in profunzime cum arata aceasta batalie invizibila si ce inseamna ea pentru fiecare dintre noi.

Inteligenta Artificiala ca Arma: Cum Sunt Folositi Algoritmii de Catre Hackeri

Poate cel mai ingrijorator aspect al intersectiei dintre AI si securitatea cibernetica este viteza cu care infractorii digitali au adoptat noile tehnologii. Daca in trecut un atac de tip phishing presupunea un email prost scris, plin de greseli gramaticale si cu un link suspect, astazi lucrurile stau cu totul altfel. Modelele lingvistice avansate, precum cele din familia GPT, pot genera emailuri de phishing perfect formulate, personalizate pentru fiecare victima in parte, bazate pe informatii publice disponibile pe LinkedIn, Facebook sau alte retele sociale.

Cercetatorii de la IBM au demonstrat intr-un experiment controlat ca atacurile de phishing generate cu ajutorul AI au o rata de succes cu 40% mai mare decat cele traditionale. Mai mult, AI-ul poate automatiza acest proces la scara masiva: in loc sa trimita 1.000 de emailuri identice, un sistem automat poate genera 1.000 de emailuri unice, fiecare adaptat profilului specific al destinatarului. Acesta este ceea ce specialistii numesc “spear phishing la scara industriala”, un fenomen care pana acum era imposibil din cauza resurselor umane necesare.

Dar phishing-ul este doar varful aisbergului. AI-ul este folosit si pentru a crea malware adaptiv, adica programe malitioase care isi pot modifica codul pentru a evita detectia de catre solutiile antivirus traditionale. Acesti virusi “inteligenti” pot analiza mediul in care ruleaza si pot decide singuri cand sa se activeze, ce date sa fure si cum sa se raspandeasca mai eficient. Compania de securitate Darktrace a raportat ca a identificat deja cazuri de malware care folosea tehnici de machine learning pentru a imita comportamentul normal al utilizatorilor, devenind practic invizibil pentru sistemele de detectie conventionale.

Deepfake-urile si Noua Era a Dezinformarii Digitale

Unul dintre cele mai alarmante produse ale AI-ului aplicat in scopuri malitioase este tehnologia deepfake. Folosind retele neuronale de tip GAN (Generative Adversarial Networks), atacatorii pot crea clipuri video si inregistrari audio in care persoane reale par sa spuna sau sa faca lucruri pe care nu le-au spus sau facut niciodata. Daca la inceput aceste falsuri erau relativ usor de identificat, astazi calitatea lor a ajuns la un nivel care inseala chiar si ochiul antrenat.

Un caz concret si extrem de grav s-a petrecut in 2019, cand directorul financiar al unei companii din Marea Britanie a transferat 243.000 de dolari catre o terta parte, convins fiind ca vorbise la telefon cu CEO-ul sau. In realitate, era o inregistrare audio generata de AI care imita perfect vocea directorului general. Acesta a fost primul caz documentat de “CEO fraud” realizat cu ajutorul inteligentei artificiale, dar cu siguranta nu si ultimul. De atunci, astfel de atacuri s-au inmultit exponential.

In Romania, fenomenul deepfake a inceput sa fie resimtit tot mai puternic, in special in contextul campaniilor de dezinformare politica si al escrocheriilor online. Politia Romana a semnalat o crestere cu peste 60% a fraudelor online in 2023 fata de 2022, o parte semnificativa dintre acestea implicand elemente de manipulare digitala. Specialistii atentioneaza ca pe masura ce uneltele de creare a deepfake-urilor devin mai accesibile si mai usor de folosit, problema se va acutiza considerabil in urmatorii ani.

AI in Aparare: Cum Revolutioneaza Inteligenta Artificiala Securitatea Cibernetica

Vestea buna este ca aceeasi tehnologie care da putere atacatorilor este folosita si de aparatori, si uneori cu rezultate remarcabile. Sistemele de securitate bazate pe AI pot analiza milioane de evenimente de retea pe secunda, identificand tipare suspecte pe care un analist uman nu le-ar putea detecta niciodata in timp util. Aceasta capacitate de procesare masiva reprezinta un avantaj decisiv intr-o lume in care atacurile se desfasoara in milisecunde.

Companiile de securitate precum CrowdStrike, SentinelOne sau Darktrace au construit platforme intregi pe baza inteligentei artificiale care invata continuu din fiecare atac, fiecare anomalie si fiecare incident de securitate. Modelele lor de machine learning pot prezice cu o acuratete surprinzatoare ce tip de atac urmeaza sa se produca, permitand organizatiilor sa se pregateasca inainte ca atacul sa aiba loc. CrowdStrike raporteaza ca platforma sa Falcon poate detecta si neutraliza o amenintare in mai putin de o secunda de la identificare, un timp de reactie imposibil de atins prin metode traditionale.

Un alt domeniu in care AI-ul face diferenta este analiza comportamentala. In loc sa se bazeze pe semnaturi virale predefinite (metoda clasica a antivirusurilor), sistemele moderne bazate pe AI analizeaza comportamentul fiecarui program si al fiecarui utilizator, creand un profil de “normalitate”. Orice deviere de la acest profil, fie ca este vorba de accesarea unor fisiere la ore neobisnuite, de transferuri de date catre locatii necunoscute sau de modificari neautorizate in registrul de sistem, declanseaza automat o alerta. Aceasta abordare, cunoscuta sub numele de User and Entity Behavior Analytics (UEBA), a revolutionat detectia amenintarilor interne, una dintre cele mai greu de identificat categorii de riscuri.

Vulnerabilitatile Infrastructurii Critice in Contextul AI

Daca atacurile impotriva companiilor private sunt ingrijoratoare, cele indreptate catre infrastructura critica, retele electrice, sisteme de apa, spitale, transporturi sau institutii financiare, sunt cu adevarat terifiante. Iar AI-ul a crescut dramatic potentialul distructiv al unor astfel de atacuri. Un exemplu elocvent este atacul asupra Colonial Pipeline din SUA din 2021, care a dus la penurie de combustibil in mai multe state americane si la plata unei rascumparari de 4.4 milioane de dolari. Desi acel atac nu a folosit AI in mod direct, specialistii avertizeaza ca urmatoarea generatie de atacuri asupra infrastructurii critice va fi orchestrata si executata in mare masura automat, cu ajutorul inteligentei artificiale.

In Europa, Agentia Uniunii Europene pentru Securitate Cibernetica (ENISA) a publicat un raport in 2023 in care identifica infrastructura critica drept cea mai vulnerabila tinta in contextul AI-ului ofensiv. Raportul subliniaza ca sistemele industriale, cunoscute sub numele de sisteme OT (Operational Technology), au fost proiectate cu decenii in urma, fara a lua in calcul amenintarile cibernetice moderne, si sunt extrem de dificil de securizat retroactiv. Romania, ca stat membru UE, este si ea obligata sa implementeze directiva NIS2, care stabileste standarde minime de securitate cibernetica tocmai pentru a proteja infrastructura critica nationala.

Situatia devine si mai complexa atunci cand luam in calcul atacurile de tip “AI poisoning”, in care un adversar introduce date false in seturile de antrenament ale modelelor AI folosite de sisteme critice. Imaginati-va un sistem AI care gestioneaza traficul aerian si care a fost “otrafit” sa ignore anumite tipuri de alerte. Consecintele pot fi catastrofale. Acesta nu mai este un scenariu ipotetic: cercetatorii de la universitati de top din lume au demonstrat in conditii de laborator ca astfel de atacuri sunt posibile si pot fi extrem de greu de detectat.

Provocarile Legislative si Etice ale AI in Securitatea Cibernetica

Pe masura ce AI-ul devine tot mai prezent in peisajul securitatii cibernetice, apar si o serie de provocari legislative si etice extrem de complexe. Cine este responsabil atunci cand un sistem AI ia o decizie gresita si blocheaza accesul unui utilizator legitim? Cum echilibram nevoia de supraveghere pentru securitate cu dreptul la viata privata? Unde tragem linia intre monitorizarea legitima si intruziunea nejustificata?

Uniunea Europeana a facut un prim pas important prin adoptarea AI Act, primul cadru legislativ comprehensiv dedicat reglementarii inteligentei artificiale la nivel global. Aceasta lege clasifica aplicatiile AI in functie de nivelul de risc pe care il prezinta si impune cerinte stricte pentru sistemele considerate “cu risc ridicat”, categorie in care intra si multe aplicatii de securitate cibernetica. Romania trebuie sa transpuna aceste reglementari in legislatia nationala, un proces care va afecta atat companiile private, cat si institutiile publice.

Dincolo de legislatie, exista si o dezbatere etica profunda in comunitatea specialistilor. Sistemele AI de securitate colecteaza cantitati uriase de date despre comportamentul utilizatorilor, iar aceasta colectare poate fi perceputa ca intruziva. Mai mult, algoritmii de detectie a amenintarilor pot fi “partinitali” daca seturile de date pe care au invatat nu sunt suficient de diverse, ducand la false pozitive care afecteaza disproportunat anumite categorii de utilizatori. Aceste probleme nu au solutii simple si vor necesita o colaborare stransa intre tehnologi, legiuitori, eticieni si societatea civila.

Securitatea Personala in Era AI: Ce Poti Face Tu

Dincolo de bataliile purtate la nivel corporativ sau guvernamental, exista lucruri concrete pe care fiecare utilizator le poate face pentru a-si imbunatati securitatea in era AI. Primul si cel mai important pas este constientizarea. Intelege ca amenintarile de astazi sunt mai sofisticate decat oricand si ca nu mai este suficient sa “nu dai click pe linkuri suspecte”. Un email generat de AI poate fi practic indistinguibil de unul autentic, asa ca trebuie sa fii mult mai vigilent si mai sceptic in general.

Autentificarea multi-factor (MFA) ramane una dintre cele mai eficiente masuri de securitate disponibile utilizatorilor obisnuiti. Chiar daca un atacator reuseste sa iti obtina parola printr-un atac phishing sau o bresa de date, MFA adauga un strat suplimentar de protectie care poate face diferenta. Specialistii recomanda folosirea unei aplicatii de autentificare (precum Google Authenticator sau Authy) in locul codurilor trimise prin SMS, deoarece acestea din urma pot fi interceptate prin atacuri de tip SIM swapping. De asemenea, utilizarea unui manager de parole este esentiala: aplicatii precum Bitwarden, 1Password sau LastPass pot genera si stoca parole unice si complexe pentru fiecare cont, eliminand riscul refolosirii parolelor.

Un alt sfat practic extrem de valoros este sa fii atent la ce informatii publici online. AI-ul folosit de hackeri pentru personalizarea atacurilor se hraneste cu datele pe care le oferim voluntar pe retelele sociale. Locul de munca, relatiile personale, preferintele, hobby-urile, toate acestea pot fi folosite pentru a construi un profil detaliat al victimei si pentru a crea atacuri de inginerie sociala extrem de convincatoare. Revizuieste periodic setarile de confidentialitate ale conturilor tale si gandeste-te de doua ori inainte de a posta informatii sensibile.

Viitorul Securitatii Cibernetice: Tendinte si Previziuni

Uitandu-ne spre viitor, este clar ca batalia dintre atacatori si aparatori va continua sa escaladeze, iar AI-ul va juca un rol central in ambele tabere. O tendinta care capata tot mai mult avant este cea a “autonomus security operations”, adica sisteme de securitate complet automatizate care pot detecta, investiga si raspunde la amenintari fara interventie umana. Desi promisatoare, aceasta abordare ridica intrebari serioase despre ce se intampla atunci cand sistemul autonomizeaza o reactie gresita.

Computatia cuantica reprezinta probabil cea mai mare provocare pe termen mediu pentru securitatea cibernetica. Computerele cuantice, odata ce vor atinge maturitatea necesara, vor putea sparge in ore sau chiar minute algoritmii de criptare care astazi necesita milioane de ani pentru a fi decriptati prin metode conventionale. Organizatiile serioase incep deja sa investeasca in “post-quantum cryptography”, adica algoritmi de criptare proiectati sa reziste atacurilor computerelor cuantice. NIST (National Institute of Standards and Technology) din SUA a standardizat deja primii astfel de algoritmi in 2024, un semnal clar ca aceasta nu mai este o preocupare pentru viitorul indepartat.

In paralel, se cristalizeaza conceptul de “security mesh”, o arhitectura de securitate distribuita si flexibila, perfect adaptata pentru lumea hibrida in care traim, cu angajati care lucreaza de acasa, date stocate in cloud-uri multiple si dispozitive IoT care prolifereaza in orice mediu. Aceasta abordare, combinata cu principiul “Zero Trust” (nu ai incredere in nimeni si nimic, verifica totul), reprezinta directia spre care se indreapta securitatea cibernetica moderna, sustinuta masiv de capabilitatile AI.

Educatia si Resursa Umana: Veriga Slaba Ramane Omul

Indiferent cat de sofisticate devin sistemele de securitate bazate pe AI, specialistii sunt unanimi intr-o privinta: veriga cea mai slaba in lantul de securitate cibernetica ramane factorul uman. Studiile arata ca peste 85% dintre brese de securitate implica un element de eroare umana, fie ca este vorba de un angajat care a dat click pe un link de phishing, de o parola slaba sau de o configurare gresita a unui sistem. Aceasta realitate subliniaza importanta critica a educatiei in domeniul securitatii cibernetice.

In Romania, constientizarea in domeniul securitatii cibernetice este inca la un nivel relativ scazut comparativ cu media europeana. Un sondaj realizat de DNSC (Directia Nationala de Securitate Cibernetica) a aratat ca mai putin de 30% dintre utilizatorii romani stiu ce este autentificarea in doi pasi si mai putin de 15% o folosesc in mod regulat. Aceste cifre sunt ingrijoratoare intr-o era in care amenintarile devin tot mai sofisticate si mai greu de recunoscut.

Companiile care investesc in traininguri regulate de securitate cibernetica pentru angajati raporteaza o reducere semnificativa a incidentelor de securitate. Platforme precum KnowBe4 sau Proofpoint ofera simulari de atacuri phishing si module de training adaptate, care ajuta angajatii sa recunoasca si sa raporteze tentativele de atac. Aceasta abordare proactiva, combinata cu tehnologia AI de detectie a amenintarilor, reprezinta modelul de securitate recomandat de expertii din domeniu pentru organizatiile de toate dimensiunile.

Inteligenta artificiala a schimbat pentru totdeauna regulile jocului in securitatea cibernetica, si nu exista cale de intoarcere. Atacatorii au acum acces la unelte de o putere si sofisticare fara precedent, capabile sa genereze amenintari la o viteza si la o scara imposibil de contracarat prin metode traditionale. In acelasi timp, aparatorii au la dispozitie tehnologii care le permit sa detecteze si sa neutralizeze amenintarile mai rapid si mai eficient decat oricand. Aceasta cursa a inarmarilor digitale va continua sa se accelereze, si fiecare dintre noi, fie ca suntem utilizatori obisnuiti, angajati ai unei companii sau decidenti politici, avem un rol de jucat in aceasta ecuatie. Informatia este prima linie de aparare: cu cat intelegem mai bine cum functioneaza aceste amenintari, cu atat suntem mai bine echipati pentru a le face fata. Ramaneti vigilenti, ramaneti informati si nu subestimati niciodata puterea unui singur click negandand.

Related posts

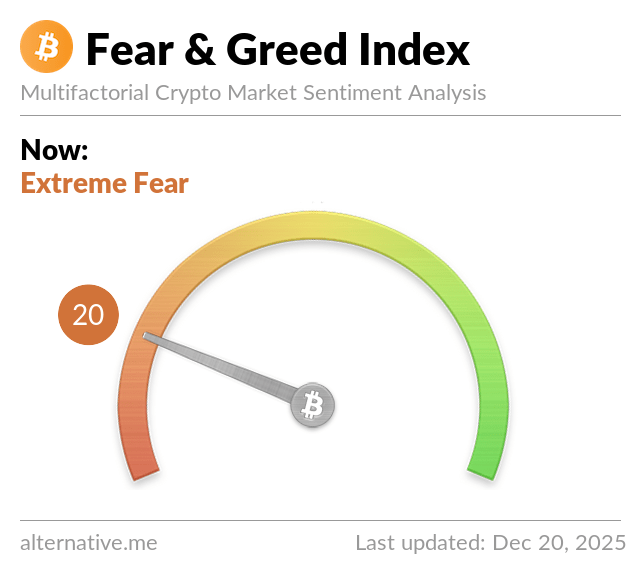

Crypto Fear Level