Imaginati-va un hacker care nu doarme niciodata, nu oboseste, nu face greseli si poate lansa mii de atacuri simultan, adaptandu-se in timp real la orice aparare intalneste. Aceasta nu mai este o scena dintr-un film SF. Este realitatea securitatii cibernetice in 2024, o era in care inteligenta artificiala a schimbat fundamental regulile jocului, atat pentru atacatori, cat si pentru aparatori. Cybersecurity-ul nu mai este doar despre firewall-uri si antivirus. A devenit un razboi tehnologic in care algoritmii se lupta intre ei, iar miza este uriasa: datele noastre personale, infrastructura critica a statelor si stabilitatea economiei globale.

Conform unui raport publicat de Cybersecurity Ventures, costul global al criminaltatii cibernetice va depasi 10.5 trilioane de dolari anual pana in 2025. Pentru comparatie, aceasta suma este mai mare decat PIB-ul majoritatii tarilor din lume. In acelasi timp, AI-ul a intrat masiv in arsenalul ambelor tabere, creand un ecosistem de amenintari si solutii fara precedent in istoria tehnologiei. In acest articol, exploram cum transforma inteligenta artificiala peisajul securitatii cibernetice, ce riscuri noi apar si ce trebuie sa stii pentru a te proteja intr-o lume digitala din ce in ce mai periculoasa.

AI-ul in mainile atacatorilor: O noua generatie de amenintari cibernetice

Cel mai ingrijorator aspect al revolutiei AI in cybersecurity este democratizarea atacurilor cibernetice sofisticate. Inainte, un atac complex necesita cunostinte tehnice avansate, timp si resurse considerabile. Astazi, cu ajutorul unor instrumente bazate pe AI, chiar si o persoana cu cunostinte tehnice minime poate lansa atacuri devastatoare. Modele de limbaj mari (LLM-uri) precum cele care stau la baza ChatGPT au fost deja utilizate pentru a genera cod malitios, emailuri de phishing personalizate si scenarii de inginerie sociala extrem de convingatoare.

Un exemplu concret este aparitia fenomenului numit “spear phishing automatizat”. In trecut, atacatorii trimiteau emailuri generice de phishing catre mii de persoane, sperind ca cineva va cadea in capcana. Acum, AI-ul poate analiza profilul public al unei persoane de pe LinkedIn, Facebook, Twitter si alte surse, pentru a genera un email personalizat care mentioneaza proiecte reale, colegi reali si contexte credibile. Rata de succes a acestor atacuri este de pana la 60% mai mare decat a phishing-ului conventional, potrivit unui studiu IBM din 2023.

Mai mult decat atat, au aparut asa-numitele “AI worms” sau viermi bazati pe inteligenta artificiala. Acestia sunt programe malitioase care se pot adapta autonom la mediul in care se afla, evitand detectia si cautand activ vulnerabilitati noi. Un experiment realizat de cercetatori de la Universitatea Cornell in 2024 a demonstrat ca un astfel de vierme AI poate compromite sisteme email bazate pe AI, extragand date sensibile si propagandu-se la alti utilizatori fara nicio interventie umana.

Deepfake-urile si ingineria sociala bazata pe AI

Una dintre cele mai alarmante utilizari ale AI-ului in atacurile cibernetice este crearea de continut deepfake folosit pentru frauda si manipulare. In 2024, o companie din Hong Kong a pierdut 25 de milioane de dolari dupa ce un angajat a fost pacalit sa transfere bani in urma unui apel video deepfake in care apareau, sau cel putin asa credea el, mai multi colegi si chiar directorul financiar al companiei. Intreaga scena a fost fabricata cu ajutorul AI-ului, folosind inregistrari video si audio reale ale persoanelor respective.

Aceasta tehnica, cunoscuta sub numele de “Business Email Compromise” (BEC) amplificata de AI, a inlocuit gradual metodele traditionale de frauda. Atacatorii nu mai au nevoie sa sparga sisteme complicate. Le este suficient sa cloneze vocea unui CEO folosind doar cateva minute de inregistrari audio disponibile public, sa genereze un video deepfake convingator si sa contacteze departamentul financiar cu o cerere urgenta de transfer. Tehnologia necesara pentru a face asta este accesibila si, in unele cazuri, gratuita.

Specialistii in securitate avertizeaza ca pana in 2026, deepfake-urile vor fi atat de avansate incat vor fi practic imposibil de detectat cu ochiul liber. Deja, instrumente comerciale de detectie a deepfake-urilor au o rata de eroare de 20-30% in conditii reale. Aceasta realitate pune o presiune enorma pe organizatii sa adopte procese de verificare multi-factor care nu se bazeaza exclusiv pe recunoasterea vizuala sau vocala.

Cum apara AI-ul sistemele: Securitate proactiva si detectie inteligenta

Vestea buna este ca aceleasi capacitati care fac AI-ul periculos in mainile atacatorilor il fac extrem de valoros si in mainile aparatorilor. Platformele moderne de securitate cibernetica bazate pe AI pot analiza miliarde de evenimente de securitate pe zi, identificand tipare suspecte pe care niciun analist uman nu le-ar putea detecta in timp real. Microsoft Security Copilot, de exemplu, poate procesa semnale de securitate de la milioane de endpoint-uri simultan si poate genera alerte cu context complet in secunde, nu in ore.

Sistemele de tip SIEM (Security Information and Event Management) de noua generatie, cum ar fi Splunk cu capabilitati AI sau IBM QRadar, folosesc machine learning pentru a stabili o “linie de baza” a comportamentului normal in retea. Orice abatere, fie ea si minima, genereaza o alerta. De exemplu, daca un angajat isi descarca in mod normal 100 de fisiere pe zi, iar sistemul detecteaza brusc o descarcare de 10.000 de fisiere la ora 3 dimineata, AI-ul blocheaza automat activitatea si alerteaza echipa de securitate, chiar daca nu exista o semnatura cunoscuta de malware asociata activitatii respective.

Un alt domeniu in care AI-ul revolutioneaza securitatea este “threat hunting” proactiv. In loc sa astepte ca un atac sa fie detectat, sistemele AI scaneaza constant retelele in cautarea indicatorilor de compromitere (IoC) si a tacticilor, tehnicilor si procedurilor (TTP) asociate grupurilor de atacatori cunoscuti. Companiile care folosesc aceste sisteme raporteaza o reducere a timpului mediu de detectie a unei brese de securitate de la 197 de zile (media globala conform IBM Cost of a Data Breach Report 2023) la cateva ore sau chiar minute.

Vulnerabilitatile AI-ului insusi: Atacuri asupra sistemelor de inteligenta artificiala

Intr-o ironie a soartei, chiar sistemele AI folosite pentru securitate pot deveni tinte ale atacurilor cibernetice. O categorie noua de atacuri, numita “adversarial AI” sau “AI poisoning”, vizeaza direct modelele de machine learning, corrumpand datele de antrenament sau manipuland inputurile pentru a induce erori in predictiile sistemului. Imaginati-va un sistem de recunoastere a malware-ului care este antrenat sa ignore un anumit tip de cod malitios prin injectarea de date false in procesul de invatare. Rezultatul este un sistem de securitate cu un unghi mort perfect exploatabil.

Atacurile de tip “prompt injection” reprezinta o alta amenintare specifica sistemelor AI. In cazul asistentilor virtuali sau al sistemelor de automatizare bazate pe LLM-uri, atacatorii pot insera instructiuni malitioase ascunse in documente sau emailuri, fortand sistemul AI sa execute actiuni nedorite. De exemplu, un email aparent inofensiv ar putea contine un text invizibil sau codificat care instruieste un asistent AI sa transfere date sensibile catre o adresa externa, ocolind toate politicile de securitate configurate de administratori.

Cercetatorii de la MITRE, organizatia care mentine faimosul framework ATT&CK pentru tacticile hackerilor, au lansat recent ATLAS (Adversarial Threat Landscape for Artificial-Intelligence Systems), un framework dedicat special documentarii atacurilor impotriva sistemelor AI. Aceasta initiativa reflecta recunoasterea faptului ca AI-ul nu este doar un instrument de securitate, ci si o suprafata de atac care trebuie protejata cu aceeasi rigoare ca orice alt sistem critic.

Ransomware-ul in era AI: Mai rapid, mai precis, mai devastator

Ransomware-ul, acea categorie de malware care cripteaza datele victimei si cere o rascumparare, a evoluat dramatic odata cu integrarea AI-ului. Grupurile de criminalitate cibernetica au inceput sa foloseasca AI pentru a identifica automat cele mai valoroase fisiere dintr-o retea inainte de a le cripta, maximizand presiunea asupra victimei. In loc sa cripteze tot ce gasesc, noii ransomware-i AI prioritizeaza bazele de date cu date ale clientilor, fisierele financiare si backup-urile, facand recuperarea fara plata rascumpararei aproape imposibila.

Un exemplu ingrijorator este grupul Lockbit, care a integrat capabilitati de automatizare avansate in infrastructura sa, reducand dramatic timpul de la compromiterea initiala a unui sistem pana la criptarea completa a retelei. Daca in 2019 un atac ransomware complet dura in medie 60 de ore, atacurile moderne bazate pe AI pot finaliza intregul proces in mai putin de 4 ore, lasand echipele de securitate fara timp suficient pentru a reactiona. Platile de rascumparare la nivel global au atins 1.1 miliarde de dolari in 2023, un record absolut.

Mai mult, AI-ul permite personalizarea cererilor de rascumparare. Sistemele automate analizeaza situatia financiara a companiei vizate, inclusiv asigurarile de cybersecurity detinute, pentru a stabili o suma de rascumparare cat mai precis calibrata la capacitatea de plata a victimei. Aceasta abordare cinica dar eficienta maximizeaza sansele ca plata sa fie efectuata si minimizeaza riscul ca suma ceruta sa fie prea mare sau prea mica.

Reglementari si cadrul legal: Cum raspunde lumea la provocarile AI in cybersecurity

Pe masura ce amenintarile cibernetice bazate pe AI se intensifica, guvernele si organizatiile internationale incearca sa tina pasul cu un cadru legislativ adecvat. Uniunea Europeana a adoptat in 2024 primul regulament comprehensiv dedicat inteligentei artificiale, cunoscut ca AI Act, care include prevederi specifice legate de utilizarea AI in aplicatii cu risc ridicat, inclusiv securitatea cibernetica. Companiile care dezvolta sau utilizeaza sisteme AI cu impact potential major sunt obligate sa efectueze evaluari de risc riguroase si sa mentina o transparenta adecvata.

In Statele Unite, National Institute of Standards and Technology (NIST) a actualizat Cybersecurity Framework la versiunea 2.0 in 2024, incluzand pentru prima data ghiduri specifice pentru securizarea sistemelor AI si pentru gestionarea riscurilor introduse de AI in infrastructura de securitate. Aceste ghiduri recomanda organizatiilor sa trateze sistemele AI ca pe active critice, sa le auditeze regulat si sa mentina capacitatea de a opera fara AI in cazul in care acestea sunt compromise.

Romania si celelalte state membre UE sunt obligate sa transpuna prevederile AI Act in legislatia nationala, ceea ce va impune modificari semnificative in modul in care companiile romanesti gestioneaza si utilizeaza sistemele AI, mai ales in sectoare sensibile precum fintech, sanatate si infrastructura critica. DNSC (Directia Nationala de Securitate Cibernetica) a anuntat deja planuri de extindere a capacitatilor de monitorizare si raspuns la incidente care implica vectori de atac bazati pe AI.

Zero Trust si AI: Arhitectura de securitate a viitorului

In contextul amenintarilor tot mai sofisticate generate de AI, arhitectura Zero Trust a devenit standardul de aur in securitatea cibernetica moderna. Principiul fundamental al Zero Trust este simplu dar revolutionary: nu ai incredere in nimeni si nimic, nici macar in utilizatorii si dispozitivele din interiorul retelei tale. Fiecare acces la orice resursa trebuie verificat continuu, indiferent de locatia utilizatorului sau de istoricul sau. AI-ul joaca un rol crucial in implementarea practica a acestui principiu, evaluand in timp real sute de factori contextuali pentru a determina daca un request de acces este legitim.

Sistemele de Identity and Access Management (IAM) bazate pe AI pot analiza comportamentul de autentificare al unui utilizator, inclusiv viteza de tastare, patternul de miscare a mouse-ului, locatia geografica, dispozitivul folosit si ora accesului, pentru a genera un “scor de incredere” dinamic. Daca scorul scade sub un anumit prag, sistemul poate solicita o autentificare suplimentara sau poate bloca accesul automat. Aceasta abordare, numita “risk-based authentication”, reduce dramatic eficienta atacurilor bazate pe credentiale furate, chiar si in cazul in care atacatorul a obtinut parola corecta.

Gianti precum Google, Microsoft si Amazon au investit miliarde de dolari in implementarea arhitecturii Zero Trust in propriile infrastructuri si in oferirea de solutii Zero Trust clientilor lor. Google BeyondCorp, lansat initial ca proiect intern, a devenit acum un produs comercial care permite companiilor sa implementeze Zero Trust fara a mai depinde de VPN-uri traditionale. Adoptia acestui model este in crestere accelerata, cu peste 72% din companiile mari la nivel global declarand ca se afla in diferite stadii de implementare Zero Trust, conform Forrester Research.

Sfaturi practice: Cum te protejezi in era AI

Dincolo de solutiile enterprise si de dezbaterile tehnice, exista pasi concreti pe care orice utilizator sau companie ii poate urma pentru a reduce riscurile de securitate in era AI. In primul rand, autentificarea multi-factor (MFA) nu mai este optionala. In conditiile in care AI-ul poate sparge parole complexe mult mai rapid decat inainte si in care phishing-ul automatizat are rate de succes tot mai ridicate, MFA este ultima linie de aparare realista impotriva accesului neautorizat. Folositi aplicatii de autentificare (Authenticator apps) in locul SMS-ului, care poate fi vulnerabil la atacuri de tip SIM swapping.

Educatia continua a angajatilor ramane cel mai eficient instrument de securitate, chiar si in era AI. Organizati sesiuni regulate de training care includ simulari de phishing bazat pe AI, exercitii de recunoastere a deepfake-urilor si proceduri clare pentru verificarea cererilor financiare sau sensibile primite prin canale digitale. Stabiliti protocoale de tip “code word” sau verificare out-of-band pentru tranzactiile importante, adica verificati printr-un canal separat (telefon direct, intalnire fizica) orice cerere mare de transfer financiar, indiferent cat de legitima pare sursa digitala.

Din perspectiva tehnica, asigurati-va ca mentineti o strategie solida de backup urmand regula 3-2-1: 3 copii ale datelor, pe 2 tipuri diferite de suport, cu 1 copie off-site sau offline. In fata ransomware-ului bazat pe AI, backup-urile offline reprezinta singura garantie reala a recuperarii datelor fara plata rascumpararilor. Actualizati constant software-ul si sistemele de operare, deoarece AI-ul atacatorilor scanseaza activ internet-ul in cautarea sistemelor vulnerabile cu patch-uri de securitate neaplicate. In plus, investiti in solutii de securitate bazate la randul lor pe AI, care pot detecta comportamente anormale inainte ca acestea sa devina incidente majore.

In concluzie, securitatea cibernetica in era AI este un domeniu in care evolutia tehnologica se produce cu o viteza ametitoare, iar echilibrul dintre atacatori si aparatori este fragil si in continua schimbare. Inteligenta artificiala a amplificat substantial capacitatile ambelor parti, transformand cybersecurity-ul dintr-o problema tehnica intr-o provocare strategica cu implicatii economice, geopolitice si sociale majore. Cheia nu sta in a te teme de aceasta evolutie, ci in a o intelege si in a te adapta proactiv la noua realitate. Fie ca esti un utilizator individual, un antreprenor sau un responsabil IT dintr-o corporatie, informatia corecta, instrumentele potrivite si o cultura solida de securitate sunt cele mai bune arme pe care le ai la dispozitie. Razboiul cibernetic al viitorului se joaca astazi, iar cei care se pregatesc acum vor fi cei care supravietuiesc si prospera in ecosistemul digital al zilei de maine.

Related posts

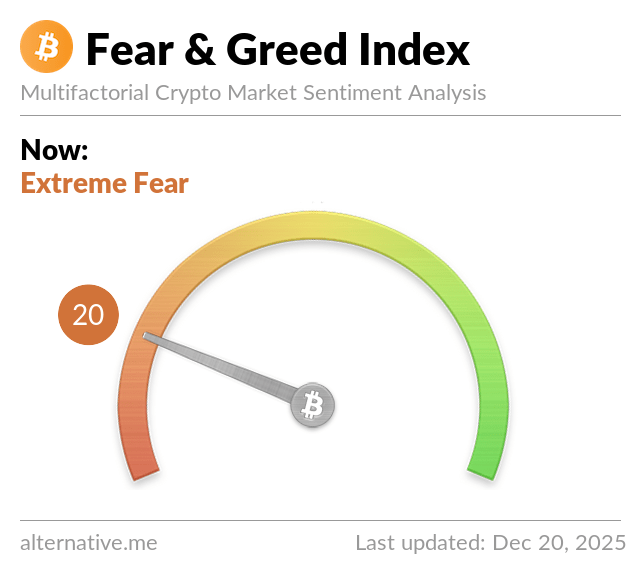

Crypto Fear Level