Traim intr-o epoca in care inteligenta artificiala nu mai este doar un concept din filmele SF, ci o realitate care reshape complet modul in care functioneaza lumea digitala. Daca pana acum securitatea cibernetica era un joc de-a soarecele si pisica intre hackeri si specialistii in IT, astazi AI-ul a transformat acest joc intr-o competitie de inalta tehnologie, in care ambele tabere folosesc aceleasi arme. Atacatorii folosesc AI pentru a lansa atacuri mai sofisticate, mai rapide si mai greu de detectat, in timp ce aparatorii folosesc acelasi AI pentru a construi sisteme de protectie mai inteligente si mai reactive. Intrebarea nu mai este daca AI-ul va schimba securitatea cibernetica, ci cat de pregatiti suntem cu totii pentru aceasta transformare radicala.

Conform unui raport publicat de Cybersecurity Ventures, daunele globale cauzate de criminalitatea cibernetica vor atinge suma astronomica de 10.5 trilioane de dolari anual pana in 2025. In acelasi timp, piata globala a solutiilor de securitate cibernetica bazate pe AI este estimata sa ajunga la peste 46 de miliarde de dolari pana in 2027, potrivit analistilor de la MarketsandMarkets. Aceste cifre nu sunt simple statistici reci – ele reprezinta realitatea unui razboi digital care se desfasoara in acest moment, in timp ce tu citesti aceste randuri.

Cum a Transformat AI Peisajul Amenintarilor Cibernetice

Pentru a intelege cu adevarat impactul inteligentei artificiale asupra securitatii cibernetice, trebuie sa facem un pas in urma si sa vedem cum arata peisajul amenintarilor inainte si dupa aparitia AI-ului accesibil publicului larg. Inainte de 2020, un atac cibernetic tipic necesita un nivel ridicat de expertiza tehnica, timp considerabil de pregatire si resurse semnificative. Un hacker care dorea sa lanseze un atac de phishing trebuia sa scrie manual emailurile de inselatorie, sa configureze infrastructura tehnica si sa testeze manual vulnerabilitatile sistemelor tinta.

Astazi, cu ajutorul modelelor de limbaj mari (LLM – Large Language Models) precum GPT-4 sau alte variante similare, un atacator cu cunostinte tehnice minime poate genera sute de emailuri de phishing personalizate in cateva minute, poate crea malware polimorf care isi schimba codul pentru a evita detectia si poate automatiza scanarea vulnerabilitatilor la o scara care ar fi fost imposibila manual. Cercetatorii de la firma de securitate WithSecure au demonstrat ca AI-ul poate fi folosit pentru a crea atacuri de spear-phishing atat de bine personalizate incat rata de succes creste cu pana la 40% comparativ cu metodele traditionale.

Mai ingrijorator este fenomenul cunoscut sub numele de “democratizarea hackerismului”. Tool-uri precum WormGPT sau FraudGPT – variante modificate ale modelelor AI populare, disponibile pe dark web – permit chiar si persoanelor fara cunostinte tehnice avansate sa lanseze atacuri sofisticate. Este ca si cum cineva ar pune in mainile unui incepator un avion de lupta in locul unui avion de pasageri: puterea de distrugere creste exponential, dar discernamantul si controlul nu tin pasul.

Deepfake-urile si Ingineria Sociala Alimentata de AI

Una dintre cele mai alarmante evolutii din intersectia AI si securitate cibernetica este explozia deepfake-urilor si a atacurilor de inginerie sociala alimentate de inteligenta artificiala. Deepfake-urile nu mai sunt doar videoclipuri amuzante in care celebrii par sa spuna lucruri ciudate – ele au devenit o arma serioasa in arsenalul atacatorilor cibernetici. In 2023, o companie din Hong Kong a pierdut echivalentul a 25 de milioane de dolari dupa ce un angajat a fost pacalit intr-un apel video deepfake in care “directorul financiar al companiei” – de fapt o simulare AI – i-a ordonat sa efectueze mai multe transferuri bancare.

Atacurile de vishing (voice phishing) au atins un nou nivel de pericol odata cu aparitia clonarii vocale prin AI. Acum, un atacator are nevoie de doar cateva secunde de audio cu vocea victimei – o inregistrare de pe YouTube, un podcast sau chiar un mesaj vocal – pentru a crea o replica convingatoare. Aceasta replica poate fi folosita pentru a suna rudele victimei, cerandu-le bani in situatii de urgenta fabricate, sau pentru a contacta departamentele IT ale companiilor, solicitand resetarea parolelor sau accesul la sisteme sensibile.

Combaterea acestor amenintari necesita o abordare multi-layer. Specialistii recomanda implementarea unor protocoale stricte de verificare a identitatii, mai ales pentru tranzactii financiare sau acces la date sensibile. Un simplu “cuvant de cod” prestabilit intre membrii echipei poate face diferenta intre a cadea victima unui atac deepfake si a-l detecta la timp. De asemenea, solutiile tehnologice de detectie a deepfake-urilor evolueaza rapid, cu companii precum Reality Defender sau Sensity AI oferind platforme specializate pentru identificarea continutului generat artificial.

AI ca Scut: Cum Apara Inteligenta Artificiala Sistemele Digitale

Vestea buna este ca acelasi AI care potentiaza atacurile cibernetice reprezinta si cea mai puternica arma de aparare disponibila astazi. Sistemele de securitate bazate pe AI functioneaza pe principiul detectiei anomaliilor: in loc sa caute pattern-uri cunoscute de atac (cum fac antivirusurile traditionale bazate pe semnatura), ele invata comportamentul normal al unui sistem sau retele si ridica alarme atunci cand ceva iese din tiparul obisnuit. Aceasta abordare este revolutionara pentru ca poate detecta atacuri zero-day – adica vulnerabilitati si tehnici de atac complet noi, pe care niciun sistem traditional nu le-ar recunoaste.

Platforme precum Darktrace, CrowdStrike Falcon sau Microsoft Defender for Endpoint folosesc modele de machine learning antrenate pe milioane de evenimente de securitate pentru a oferi protectie in timp real. Darktrace, de exemplu, foloseste un concept numit “Enterprise Immune System” – o analogie cu sistemul imunitar uman – care invata ce este “normal” pentru fiecare retea in parte si raspunde autonom la amenintari, putand izola un endpoint compromis in milisecunde, mult mai rapid decat orice echipa umana ar putea reactiona.

Un alt domeniu in care AI exceleza in aparare este analiza comportamentala a utilizatorilor (UEBA – User and Entity Behavior Analytics). Aceste sisteme monitorizeaza continuu activitatea utilizatorilor si pot detecta semne subtile ale unui cont compromis sau ale unui insider threat: de exemplu, un angajat care acceseaza in mod normal 50 de fisiere pe zi si brusc incepe sa acceseze 5.000 intr-o ora, sau un utilizator care se autentifica la 3 dimineata din o tara diferita de cea in care locuieste. IBM QRadar si Splunk sunt doua dintre cele mai cunoscute platforme care integreaza capabilitati UEBA avansate.

Vulnerabilitatile AI Insusi: Cand Aparatorul Devine Tinta

Intr-o ironie delicioasa a erei digitale, sistemele AI folosite pentru securitate cibernetica sunt ele insele vulnerabile la atacuri sofisticate. Cercetatorii au identificat mai multe categorii de atacuri specifice modelelor AI, iar intelegerea acestora este cruciala pentru oricine doreste sa implementeze solutii de securitate bazate pe inteligenta artificiala. Primul si poate cel mai ingrijorator este “adversarial attack” sau atacul adversarial: prin modificari minuscule, imperceptibile pentru ochiul uman, ale datelor de input, atacatorii pot face ca un model AI sa produca rezultate complet gresite.

Imaginati-va un sistem AI de recunoastere faciala folosit pentru controlul accesului intr-o cladire securizata. Un atacator suficient de sofisticat ar putea adauga pe fata sa un pattern de pixeli special conceput – practic invizibil pentru un observator uman – care face ca sistemul AI sa il identifice ca o alta persoana, cu drepturi de acces superioare. Acest tip de atac a fost demonstrat in medii de laborator de catre cercetatorii de la MIT, Berkeley si alte institutii de top, si reprezinta o amenintare reala pentru sistemele de securitate fizica si digitala deopotriva.

O alta categorie de vulnerabilitati AI este “data poisoning” sau otravirea datelor de antrenament. Daca un atacator reuseste sa introduca date malitioase in setul de date folosit pentru antrenarea unui model AI de securitate, poate crea “backdoor-uri” – situatii specifice in care modelul va esua deliberat sau va ignora anumite tipuri de amenintari. Protectia impotriva acestor atacuri necesita procese riguroase de validare si sanitizare a datelor de antrenament, precum si monitorizarea continua a performantei modelelor in productie.

Ransomware-ul in Era AI: O Amenintare Amplificata

Ransomware-ul – tipul de malware care iti cripteaza datele si cere rascumparare pentru deblocare – a fost deja una dintre cele mai devastatoare amenintari cibernetice ale ultimului deceniu. Atacul asupra Colonial Pipeline din 2021, care a paralizat aprovizionarea cu combustibil pe Coasta de Est a SUA, sau atacul asupra sistemului de sanatate irlandez HSE, care a costat sute de milioane de euro si a pus in pericol vieti omenesti, au aratat cat de serioase pot fi consecintele. Dar cu AI in ecuatie, ransomware-ul devine o amenintare si mai formidabila.

Grupurile de criminalitate cibernetica folosesc acum AI pentru a automatiza identificarea victimelor de mare valoare, pentru a optimiza momentul atacurilor (de exemplu, lansand atacuri in weekend-uri sau sarbatori, cand echipele IT sunt mai putine) si pentru a personaliza mesajele de rascumparare pentru a maximiza sansele de plata. Mai mult, AI permite crearea de ransomware polimorf care isi modifica codul in mod continuu, facandu-l extrem de dificil de detectat de catre solutiile antivirus traditionale.

Pentru protectia impotriva ransomware-ului in era AI, expertii in securitate recomanda o strategie de aparare in adancime: backup-uri regulate si testate ale datelor critice (regula 3-2-1: 3 copii, pe 2 tipuri diferite de media, cu 1 copie off-site sau in cloud), segmentarea retelei pentru a limita raspandirea in caz de compromitere, implementarea principiului least privilege (utilizatorii au acces doar la resursele de care au nevoie), si trainingul regulat al angajatilor pentru recunoasterea tentativelor de phishing. Companiile care au implementat aceste masuri au raportat reduceri semnificative ale impactului atacurilor, chiar si atunci cand au cazut victime.

Reglementarile si Cadrul Legal: Europa in Fruntea Cursei

In fata acestor amenintari in continua evolutie, guvernele si organizatiile internationale au inceput sa raspunda prin reglementari mai stricte si cadre legale adaptate erei AI. Uniunea Europeana se afla in fruntea acestei curse normative, cu doua instrumente legislative majore care vor remodela peisajul securitatii cibernetice in anii urmatori. AI Act, adoptat in 2024, este prima lege cuprinzatoare privind inteligenta artificiala din lume si clasifica sistemele AI in functie de riscul pe care il prezinta, impunand cerinte stricte pentru aplicatiile de inalta risc, inclusiv cele folosite in securitate cibernetica si infrastructura critica.

In paralel, Directiva NIS2 (Network and Information Security 2), care a intrat in vigoare la nivel european in octombrie 2024, extinde semnificativ aria organizatiilor obligate sa respecte standarde ridicate de securitate cibernetica si introduce sanctiuni mult mai dure pentru neconformitate – amenzi de pana la 10 milioane de euro sau 2% din cifra de afaceri globala, similar cu GDPR. Romania transpune aceasta directiva prin lege nationala, iar companiile romanesti care opereaza in sectoare critice – energie, transport, sanatate, servicii financiare – trebuie sa se pregateasca pentru audit-uri si cerinte de raportare mai stricte.

Pentru companiile mici si mijlocii, conformitatea cu aceste reglementari poate parea descurajanta, dar exista resurse disponibile. ENISA (Agentia Europeana pentru Securitate Cibernetica) publica ghiduri gratuite si detaliate pentru implementarea masurilor de securitate. In Romania, DNSC (Directia Nationala de Securitate Cibernetica) ofera asistenta si resurse educationale pentru organizatii de toate dimensiunile. Investitia in conformitate nu este doar o obligatie legala – este o investitie in rezilienta si credibilitatea afacerii tale.

Sfaturi Practice: Cum Te Protejezi in Era AI

Dincolo de teorii si statistici, ce poate face concret un utilizator obisnuit sau o companie de dimensiuni medii pentru a se proteja in aceasta era a amenintarilor potentate de AI? In primul rand, autentificarea in doi factori (2FA) sau, si mai bine, autentificarea multi-factor (MFA) ramane una dintre cele mai eficiente masuri de securitate disponibile. Conform Microsoft, MFA blocheaza aproximativ 99.9% din atacurile automate de tip credential stuffing si brute force. Activarea MFA pe toate conturile importante – email, banking, social media, cloud storage – ar trebui sa fie primul pas pentru oricine.

In al doilea rand, educatia continua este esentiala. Phishing-ul ramane vectorul de atac numarul unu, responsabil pentru peste 90% din breele de securitate conform raportului Verizon Data Breach Investigations Report 2023. Invatati sa recunoasteti semnele unui email de phishing: urgenta artificiala, domenii de email usor modificate (de exemplu, amazon-support.com in loc de amazon.com), solicitari neobisnuite de informatii personale sau financiare. Cu AI in ecuatie, aceste emailuri devin tot mai convingatoare, deci scepticismul sanatos este mai valoros ca oricand.

Pentru companii, implementarea unui program de Security Awareness Training este investitia cu cel mai bun ROI in securitate cibernetica. Platforme precum KnowBe4, Proofpoint Security Awareness sau Cofense permit simularea de atacuri de phishing in conditii controlate, identificand angajatii vulnerabili si oferindu-le training personalizat. Studiile arata ca organizatiile care deruleaza astfel de programe reduc rata de click pe linkuri de phishing cu pana la 70% in decurs de un an. In plus, adoptarea unui password manager – LastPass, 1Password sau Bitwarden sunt optiuni populare – elimina tentatia de a folosi aceeasi parola pentru mai multe conturi, o practica extrem de riscanta.

Viitorul Securitatii Cibernetice: Zero Trust si AI Colaborativ

Privind spre viitor, doua concepte vor domina evolutia securitatii cibernetice in urmatorii ani: arhitectura Zero Trust si AI-ul colaborativ. Zero Trust reprezinta o schimbare fundamentala de paradigma fata de modelul traditional de securitate bazat pe perimetru (“tot ce e in interiorul retelei e de incredere, tot ce e in exterior e suspect”). In modelul Zero Trust, nu ai incredere in nimeni si nimic, indiferent de locatia in retea: fiecare cerere de acces trebuie verificata explicit, accesul este acordat cu privilegii minime necesare, si se presupune permanent ca sistemul poate fi deja compromis.

Aceasta abordare este deosebit de relevanta in era muncii remote si a cloud computing-ului, unde perimetrul traditional al retelei corporative a disparut practic. Giganti precum Google au adoptat deja principiile Zero Trust la scara larga (initiativa lor BeyondCorp este studiata ca model de industrie), iar Gartner estimeaza ca pana in 2026, 10% din marile companii vor avea programe Zero Trust mature si masurabile, fata de mai putin de 1% in prezent. In Romania, adoptarea acestei arhitecturi este inca la inceput, dar companiile tech si institutiile financiare sunt primele care exploreaza implementari concrete.

Cat despre AI-ul colaborativ in securitate, viziunea este crearea unor ecosisteme in care sistemele AI din diferite organizatii si industrii pot impartasi informatii despre amenintari in timp real, fara a compromite datele sensibile ale fiecarei organizatii in parte – un concept cunoscut sub numele de Federated Learning sau threat intelligence sharing. Initiative precum MITRE ATT&CK Framework sau Information Sharing and Analysis Centers (ISACs) sunt precursorii acestei viziuni colaborative, si cu AI in ecuatie, viteza si acuratetea cu care informatiile despre amenintari circula intre organizatii vor creste dramatic.

In concluzie, securitatea cibernetica in era AI este un camp de lupta in care regulile se schimba cu o viteza ametitoare. Inteligenta artificiala a amplificat atat puterea atacatorilor, cat si capacitatea aparatorilor, creand o cursa a inarmarilor digitale fara precedent. Nu exista solutii perfecte si nu exista un nivel de protectie care sa garanteze invulnerabilitatea absoluta. Dar exista o diferenta enorma intre organizatiile si persoanele care abordeaza proactiv securitatea cibernetica – educandu-se continuu, implementand masuri de baza si investind in solutii moderne – si cele care raman pasive, sperând ca nu vor deveni tinte. In 2024 si dincolo de el, securitatea cibernetica nu mai este optionala: este o componenta fundamentala a vietii digitale, la fel de importanta ca incuierea usii de la intrare sau purtarea centurii de siguranta. Alegerea de a fi informat si pregatit este singurul avantaj real pe care il ai intr-un peisaj de amenintari care evolueaza cu viteza luminii.

Related posts

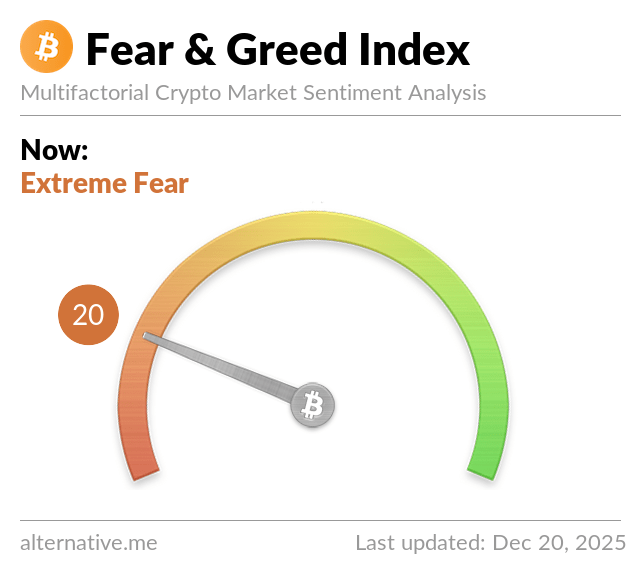

Crypto Fear Level