Traim intr-o epoca in care inteligenta artificiala nu mai este doar un concept din filmele SF, ci o realitate care reshape-uieste fiecare aspect al vietii noastre digitale. De la asistentii virtuali care ne organizeaza programul, pana la algoritmii care detecteaza fraude bancare in timp real, AI-ul a devenit coloana vertebrala a tehnologiei moderne. Insa aceasta revolutie tehnologica vine cu un pret pe care putini il inteleg cu adevarat: peisajul securitatii cibernetice s-a transformat radical, iar regulile jocului s-au schimbat complet. Atacatorii folosesc aceleasi instrumente pe care le folosim si noi pentru a ne apara, iar aceasta cursa a inarmarii digitale devine tot mai intensa si mai periculoasa pe zi ce trece.

Conform unui raport publicat de Cybersecurity Ventures, daunele globale cauzate de criminalitatea cibernetica vor atinge suma astronomica de 10,5 trilioane de dolari anual pana in 2025. Iar conform IBM, costul mediu al unei brese de securitate a ajuns la 4,45 milioane de dolari in 2023, un record istoric. In acest context, intrebarea nu mai este daca vom fi atacati, ci cand si cat de bine suntem pregatiti sa raspundem. Inteligenta artificiala a intrat in aceasta ecuatie ca un factor multiplicator, amplificand atat capacitatile de aparare, cat si armamentul celor care vor sa ne faca rau.

In acest articol, vom explora in profunzime modul in care AI-ul reshapeaza securitatea cibernetica, care sunt principalele amenintari generate de aceasta tehnologie, dar si cum ne putem folosi de ea pentru a ne proteja mai eficient. Fie ca esti un utilizator obisnuit, un profesionist IT sau un antreprenor care vrea sa-si protejeze afacerea, informatiile de mai jos iti vor oferi o perspectiva completa si practica asupra acestui subiect extrem de relevant.

AI-ul in serviciul atacatorilor: O noua generatie de amenintari cibernetice

Daca acum cativa ani, un atac cibernetic sofisticat necesita echipe de hackeri experimentati, saptamani de planificare si resurse tehnice considerabile, astazi lucrurile stau foarte diferit. Instrumente bazate pe AI pot automatiza intreg procesul de atac, de la identificarea vulnerabilitatilor si pana la executia efectiva a bresei de securitate. Modelele de tip Large Language Model (LLM) pot genera cod malitios, pot scrie emailuri de phishing aproape imposibil de detectat si pot imita cu precizie stilul de scriere al unor persoane reale.

Un exemplu concret este fenomenul denumit “spear phishing potentiat de AI”. Spre deosebire de emailurile de phishing traditionale, pline de greseli gramaticale si formulari stangace, noile atacuri sunt personalizate la nivel individual. AI-ul analizeaza profilurile publice ale victimelor pe LinkedIn, Facebook sau Twitter, extrage informatii despre angajator, colegi, proiecte recente si hobby-uri, apoi genereaza un email perfect contextual, care pare sa vina de la o persoana de incredere. Rata de succes a acestor atacuri este cu 60% mai mare decat a celor traditionale, conform unui studiu realizat de cercetatorii de la Universitatea din Oxford.

Mai ingrijorator este fenomenul “malware as a service” potentiat de AI. Platforme obscure de pe dark web ofera acum instrumente care pot crea variante noi de malware la cerere, adaptate specific pentru a eluda solutiile de securitate existente. Aceste instrumente nu mai necesita cunostinte de programare avansate – oricine cu intentii malitioase si cateva sute de dolari poate lansa un atac sofisticat. Democratizarea atacurilor cibernetice, facilitata de AI, reprezinta poate cea mai mare provocare a deceniului pentru specialistii in securitate.

Deepfake-urile: Cand nu mai poti crede ce vezi si auzi

Una dintre cele mai alarmante manifestari ale AI-ului in spatiul securitatii cibernetice este proliferarea deepfake-urilor. Aceasta tehnologie, care foloseste retele neurale generative pentru a crea continut video si audio fals extrem de realist, a evoluat intr-un ritm ametitor. Daca in 2018 un deepfake bun necesita saptamani de procesare si echipamente specializate, in 2024 poti genera un video convingator in cateva minute pe un laptop obisnuit.

Implicatiile pentru securitate sunt enorme. In 2023, o companie din Hong Kong a pierdut 25 de milioane de dolari dupa ce un angajat a fost pacalit de un deepfake al directorului financiar al companiei, care i-a dat instructiuni sa efectueze mai multe transferuri bancare intr-o videoconferinta. Angajatul a verificat identitatea prin video, nu si-a dat seama ca vorbea cu un avatar generat de AI, si a executat ordinele. Cazul a facut inconjurul lumii si a deschis ochii multor organizatii asupra noii realitati a fraudei executive.

La nivel personal, deepfake-urile sunt folosite pentru santaj, dezinformare si manipulare publica. Potrivit unui raport al companiei Sensity AI, numarul de deepfake-uri malitioase a crescut cu 900% intre 2019 si 2023. In Romania, cazurile de deepfake folosite in scheme de frauda online au crescut ingrijorator, in special pe platformele de socializare, unde videoclipuri false cu personalitati publice promoveaza investitii dubioase sau produse inexistente. Sfatul principal pentru a te proteja: verifica intotdeauna informatiile prin canale alternative, nu te baza exclusiv pe ceea ce vezi intr-un video, si fii extrem de sceptic fata de orice solicitare urgenta de transfer de bani, indiferent de cine pare sa vina.

AI in aparare: Detectia amenintarilor in timp real

Vestea buna este ca aceleasi capabilitati care fac AI-ul periculos il fac si extrem de util in aparare. Platformele moderne de securitate cibernetica folosesc inteligenta artificiala pentru a analiza miliarde de evenimente de securitate pe zi, identificand tipare suspecte pe care un om nu le-ar putea detecta niciodata in timp util. Aceasta abordare, cunoscuta sub numele de Security Information and Event Management (SIEM) potentiat de AI, a revolutionat modul in care organizatiile detecteaza si raspund la incidente.

Companii precum CrowdStrike, Darktrace sau SentinelOne au construit platforme de securitate bazate pe AI care pot detecta comportamente anomale cu o acuratete remarcabila. De exemplu, Darktrace foloseste un model de AI inspirat din sistemul imunitar uman – la fel cum corpul nostru invata sa recunoasca si sa combata agentii patogeni, platforma lor invata comportamentul normal al fiecarui utilizator si dispozitiv dintr-o retea, alertand imediat cand ceva deviaza de la norma. Aceasta abordare bazata pe comportament, mai degraba decat pe semnatura, ii permite sa detecteze si atacuri zero-day, adica amenintari necunoscute anterior.

Un alt domeniu in care AI-ul exceleaza in aparare este analiza predictiva. Prin procesarea unor cantitati uriase de date despre vulnerabilitati cunoscute, tactici ale atacatorilor si configuratii de sistem, modelele AI pot prezice cu o probabilitate ridicata care sisteme sunt cele mai expuse si ce tipuri de atacuri sunt mai probabile in viitorul apropiat. Astfel, echipele de securitate pot prioritiza mai bine resursele limitate si pot actiona proactiv, in loc sa reactioneze dupa ce atacul a avut loc. Conform unui studiu Ponemon Institute, organizatiile care folosesc AI in securitate economisesc in medie 1,76 milioane de dolari per incident de securitate comparativ cu cele care nu folosesc aceste tehnologii.

Vulnerabilitatile modelelor AI: Cand apararatorul devine tinta

Intr-o ironie a destinului tehnologic, sistemele AI folosite pentru securitate sunt ele insele vulnerabile la atacuri sofisticate. O categorie relativ noua de atacuri, denumita “adversarial attacks”, vizeaza exact punctele slabe ale modelelor de machine learning. Atacatorii pot modifica subtil inputul unui sistem AI – de exemplu, adaugand pixeli imperceptibili pentru ochiul uman intr-o imagine – pentru a face sistemul sa ia decizii complet gresite. Imaginati-va un sistem de recunoastere faciala folosit pentru autentificare care este pacalit sa recunoasca o persoana neautorizata ca find una autorizata.

Un alt vector de atac extrem de ingrijorator este “prompt injection” in cazul sistemelor bazate pe modele de limbaj. Daca o organizatie foloseste un chatbot AI pentru suport tehnic sau pentru procesarea documentelor, un atacator poate introduce instructiuni malitioase in textele procesate de sistem, determinandu-l sa divulge informatii confidentiale, sa execute actiuni nepermise sau sa ignore regulile de securitate. Pe masura ce companiile integreaza tot mai mult AI in fluxurile lor de lucru, suprafata de atac creste proportional.

Exista si problema “data poisoning”, in care atacatorii compromit datele de antrenament ale unui model AI inainte ca acesta sa fie deployed. Daca reusesc sa introduca date false sau malitioase in setul de antrenament, pot face ca modelul sa se comporte gresit in moduri greu de detectat, dar extrem de danatoase. Aceasta amenintare este deosebit de relevanta pentru modelele AI folosite in detectia fraudelor financiare sau in sistemele medicale. Combaterea acestor vulnerabilitati necesita abordari complet noi, precum verificarea riguroasa a datelor de antrenament si testarea adversariala sistematica a modelelor inainte de deployment.

Reglementarile si cadrul legal: Europa in fruntea luptei pentru securitate AI

Recunoscand pericolele pe care le aduce AI-ul necontrolat, Uniunea Europeana a facut un pas indraznet cu adoptarea AI Act in 2024, primul cadru legislativ complet dedicat inteligentei artificiale la nivel mondial. Aceasta legislatie clasifica sistemele AI in functie de riscul pe care il reprezinta si impune cerinte stricte pentru cele din categoriile de risc ridicat, inclusiv cele folosite in securitate cibernetica, recunoastere faciala sau infrastructure critica. Romania, ca stat membru UE, este obligata sa implementeze aceste reglementari, ceea ce va aduce schimbari semnificative pentru companiile care dezvolta sau folosesc AI.

GDPR-ul, intrat in vigoare in 2018, a pus deja bazele unui cadru de protectie a datelor personale, iar interactiunea dintre GDPR si AI Act creeaza un ecosistem legislativ complex pe care companiile trebuie sa il navigheze cu atentie. De exemplu, folosirea AI pentru monitorizarea angajatilor sau pentru profilarea clientilor ridica intrebari serioase despre conformitatea cu ambele seturi de reglementari. In Romania, Autoritatea Nationala de Supraveghere a Prelucrarii Datelor cu Caracter Personal (ANSPDCP) a inceput sa acorde mai multa atentie cazurilor care implica AI, iar amenzile pot ajunge la 4% din cifra de afaceri globala a companiei.

Pe langa cadrul european, trebuie mentionat si rolul agentiilor internationale precum ENISA (Agentia Uniunii Europene pentru Securitate Cibernetica), care publica ghiduri si recomandari specifice pentru securizarea sistemelor AI. Romania are propriul sau CERT national (CERT-RO), care colaboreaza cu ENISA si cu omologii din alte tari pentru a raspunde coordonat la amenintarile cibernetice care depasesc granitele nationale. Intr-o lume in care atacurile cibernetice sunt prin definitie transnationale, colaborarea internationala nu este optionala, ci esentiala.

Sfaturi practice: Cum te poti proteja in era AI

Dincolo de marile batalii duse de corporatii si guverne, exista lucruri concrete pe care fiecare utilizator le poate face pentru a-si imbunatati postura de securitate cibernetica in era AI. Primul si cel mai important pas este educatia continua. Amenintarile evolueaza rapid, iar ceea ce stiai acum doi ani despre phishing sau malware poate fi deja depasit. Urmareste surse de incredere in domeniu (publicatii precum ryze.ro, Wired Security, Krebs on Security), participa la webinarii de securitate si familiarizeaza-te cu cele mai recente tipuri de atacuri.

Autentificarea in doi factori (2FA) ramane una dintre cele mai eficiente masuri de securitate, chiar si in contextul atacurilor potentiate de AI. Chiar daca un atacator reuseste sa-ti obtina parola prin phishing sau prin o bresa de date, fara al doilea factor (un cod generat de o aplicatie precum Google Authenticator sau o cheie hardware FIDO2) nu poate accesa contul tau. Evita 2FA prin SMS daca poti, deoarece atacurile de tip SIM swapping pot compromite aceasta metoda. Foloseste in schimb aplicatii de autentificare sau chei hardware fizice.

Pentru companii si profesionisti IT, investitia intr-o solutie de securitate care incorporeaza AI nu mai este un lux, ci o necesitate. Solutii precum Microsoft Defender for Endpoint, CrowdStrike Falcon sau Sophos Intercept X ofera protectie bazata pe comportament si detectie potentata de AI, care poate face diferenta intre a detecta un atac in cateva minute si a-l descoperi dupa ce daunele sunt deja facute. De asemenea, implementarea unui program de backup regulat cu regula 3-2-1 (3 copii ale datelor, pe 2 tipuri diferite de suport, cu 1 copie off-site) poate face diferenta intre supravietuirea si disparitia unei afaceri in cazul unui atac ransomware.

Viitorul securitatii cibernetice: Ce ne asteapta

Privind catre viitor, este clar ca granita dintre atacatori si aparatori va continua sa fie definita in mare masura de capacitatile AI pe care fiecare parte le are la dispozitie. Calculul cuantic, care promite sa revolutioneze procesarea informatiei, adauga un alt nivel de complexitate: algoritmii de criptare pe care ne bazam astazi pentru securizarea datelor ar putea fi spart in secunde de un calculator cuantic suficient de puternic. Aceasta perspectiva a determinat NIST (Institutul National de Standarde si Tehnologie din SUA) sa inceapa deja standardizarea algoritmilor de criptografie post-cuantica, iar organizatiile ar trebui sa inceapa sa se pregateasca pentru aceasta tranzitie.

Un alt trend emergent este “Zero Trust Security”, o filozofie care abandoneaza complet conceptul de perimetru de securitate. In modelul traditional, odata ce esti in interiorul retelei corporative, esti considerat de incredere. Zero Trust spune ca nu trebuie sa ai incredere in nimeni si in nimic in mod implicit, verificand constant identitatea si contextul fiecarei cereri de acces. AI-ul joaca un rol crucial in implementarea Zero Trust la scara, analizand continuu comportamentul utilizatorilor si dispozitivelor pentru a detecta anomalii care ar putea indica o compromitere.

Pe termen lung, probabil ca vom asista la aparitia unor sisteme de securitate complet autonome, capabile sa detecteze, sa analizeze si sa raspunda la atacuri fara interventie umana, in milisecunde. Dar aceasta autonomie ridica si intrebari etice profunde: cine este responsabil cand un sistem AI ia o decizie gresita si blocheaza accesul legitim la servicii critice? Sau cand escaladeaza un raspuns la un incident intr-un mod care cauzeaza daune colaterale? Echilibrul intre autonomia AI si supravegherea umana va fi una dintre marile provocari ale deceniului urmator in securitatea cibernetica.

Concluzie: Intr-o lume in care AI-ul a schimbat regulile jocului in securitatea cibernetica, ignoranta nu mai este o optiune. Fie ca esti un simplu utilizator de internet, un antreprenor sau un specialist IT, trebuie sa intelegi noile realitati ale peisajului de amenintari si sa iti adaptezi comportamentul si strategiile de protectie in consecinta. AI-ul este simultan cel mai puternic instrument de aparare si cel mai periculos vector de atac pe care l-am cunoscut vreodata – iar modul in care alegem sa il folosim si sa ne pregatim impotriva utilizarii lui abuzive va defini siguranta noastra digitala pentru deceniile care vin. Investeste in educatie, adopta practici de securitate solide, tine pasul cu evolutiile din domeniu si nu subestima niciodata creativitatea celor care vor sa exploateze vulnerabilitatile tale. In era AI, securitatea cibernetica nu mai este doar un departament din companie, ci o responsabilitate colectiva a fiecaruia dintre noi.

Related posts

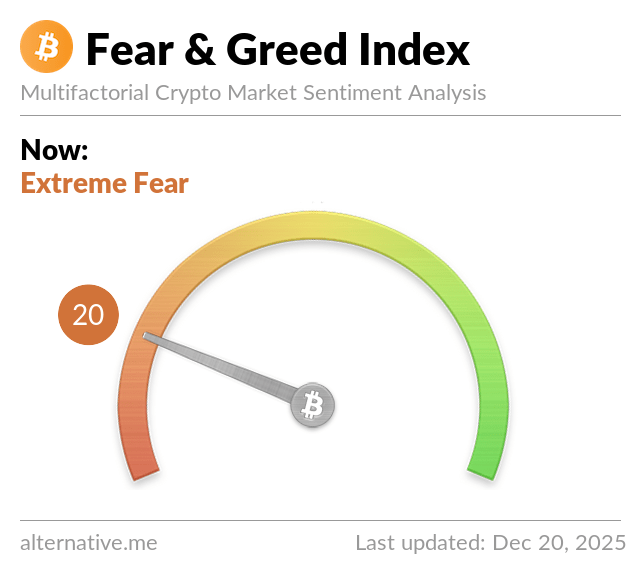

Crypto Fear Level